Intelligence humaine - l'IA pour les Ressources Humaines #4

Comment les progrès réalisés sur la forme, permettent de nous améliorer sur le fond.

Nous sommes Maxime Le Bras, Responsable du Recrutement d’Alan, et Charles Gorintin, Cofondateur et CTO d’Alan, pour vous donner de la tech et du RH. Ceci est une newsletter portant sur l’utilisation de l’Intelligence Artificielle (IA) par les spécialistes des ressources humaines. C’est promis, elle n’est pas générée par ChatGPT.

L’IA générative, comme ChatGPT, est si simple à utiliser qu’on en oublie parfois de faire le travail de fond.

Historiquement, si la forme était bonne, on pouvait se dire que le fond serait cohérent : il fallait faire un effort pour la forme, qui ne se justifiait que si le fond avait un peu de consistance.

Ces IA rendent gratuite la bonne forme. Ça permet aux “mauvais élèves” de pouvoir mieux écrire, et d’être moins pénalisés sur la forme.

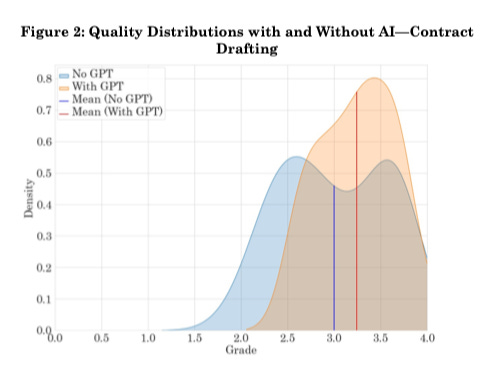

Exemple dans une étude de l’université du Minnesota sur des étudiants en Droit. GPT (l’IA) augmente sensiblement les notes, et rapproche la bosse des mauvais élèves.

On peut en retenir que l’IA ne fait pas tout ! Si elle complétait de manière autonome tout le travail sur le fond, on verrait quasiment tout le monde avec d’excellentes notes.

Et c’est compréhensible : l’IA ne peut pas deviner ce que l’on souhaite dire, elle peut donner des résultats probables. Dans les mots prémonitoires de Proust : “Les idées formées par l’intelligence pure n’ont qu’une vérité logique, une vérité possible, leur élection est arbitraire.” Mais la réalité n’est pas arbitraire, c’est encore aujourd’hui à l’humain de donner les bonnes idées de fond pour avoir un résultat excellent.

Un Alaner s’en est récemment plaint : “j’ai peur de lire ces résumés faits par l’IA - ils sont difficiles à lire, écrits dans un langage trop formel, et donnent une excuse pour ne pas donner sa propre opinion”.

C’est évidemment un des risques de l’utilisation à l’extrême de l’IA.

Alors concrètement, que faire ?

Quelques idées :

Identifier rapidement le contenu non retouché par un humain. Mon secret c’est de regarder les titres. ChatGPT a tendance à capitaliser les mots. Ce qui ne se fait pas en français.

Éduquer les équipes pour qu’elles réfléchissent et pensent à des idées de fond avant de les passer dans l’IA. Et pousser à rééditer le contenu créé pour qu’il soit profond.

Attention à ne pas croire que tout est généré par l’IA : il n’y a pas de méthode fiable aujourd’hui pour dire à coup sûr ce qui est généré par une IA. Et le rejeter systématiquement ne serait de toutes façons pas souhaitable.

Ne pas se fier à la forme pour la qualité d’une réponse !

Trois questions pour deux experts

Est-ce que vous pouvez vous présenter, et présenter l’activité de Thaé ?

— Flora : Thaé est une agence de philosophie que j’ai co-fondée en 2013 avec l’ambition d’aider les organisations à y voir clair dans les enjeux qui impactent le monde du travail : questionner leurs certitudes, dialoguer, décrypter les impensés. Nous animons des réflexions philosophiques sur des sujets aussi divers que le management, la confiance, la coopération mais aussi, depuis quelques mois, sur les enjeux éthiques de l’intelligence artificielle.

— Julien : De mon côté, j’ai rejoint Thaé il y a deux ans, après avoir travaillé avec l’agence en freelance pendant plusieurs années et terminé ma thèse de doctorat en philosophie sur les robots sociaux.

Est-ce que vous pouvez présenter également les tensions/questions que vous avez identifiées récemment concernant l’Intelligence Artificielle, et son impact sur le monde du travail ?

— Flora : L’arrivée, depuis quelques années, des systèmes d’IA dans le monde du travail vient poser deux questions majeures. Premièrement : qu’est-ce que le travail ? À quoi et à qui doit-il servir ? Deuxièmement : en quoi l'IA modifie-t-elle notre rapport pratique et vécu au travail, c’est-à-dire ce que nous y faisons et la façon dont nous le vivons ?

— Julien : A cet égard, une première tension est celle du rapport (très ancien) entre travail et automatisation : jusqu’où automatiser et pourquoi ? En découle une série d’autres questions. Par exemple, on entend un peu partout que les IA vont permettre aux professionnel.le.s de se concentrer sur les tâches essentielles (i.e. à forte valeur ajoutée) ; mais, là encore, essentielles pour qui et pourquoi ? En outre, cet essentiel n’est jamais vraiment défini et devient implicitement synonyme de « ce que les IA ne savent pas faire ». Or, l’histoire récente montre que les domaines réputés inaccessibles aux IA ne cessent de se réduire (pensons, par exemple, aux métiers de la création) et que, face aux machines, c’est l’humain lui-même qui est questionné, notamment en termes de « valeur ajoutée ».

— Flora : Or, travailler ne consiste pas seulement à effectuer des tâches (ce que l’IA peut très bien faire à notre place), mais aussi à penser ensemble, à débattre de ce qui fait problème, de la pertinence de telle ou telle solution… Travailler, c’est faire l’expérience d’une certaine forme de relation humaine. Il y a une dimension politique au travail : c’est un endroit où l’on s’éprouve, où l’on fait société. Le télétravail comme l’IA ont d’énormes avantages pratiques, mais ne remplacent pas cette dimension essentielle de la présence (parfois confrontante) de l’autre.

— Julien : Conséquence logique de tout cela et deuxième tension : les IA rebattent les cartes de la compétence et de l’apprentissage d’un métier, y compris lorsqu’on n’est pas entièrement remplacé.e par une machine. Les IA participent-elles à l’acquisition de nouvelles compétences ou vont-elles plutôt se solder par une « perte sèche » ? Au final, tous ces points convergent vers une seule et même question qui est celle de la valeur du travail, dans ses dimensions à la fois politique, morale, économique et existentielle.

En tant que manager, comment évaluer la performance d’un employé qui est maintenant “augmenté” grâce à l’intelligence artificielle ? Quelles sont les compétences que vont devoir développer les managers ?

— Flora : Il faut manier cette notion d’augmentation avec beaucoup de prudence. L’IA est, comme toute technologie, ce qu’on appelle en philosophie un pharmakon, c’est-à-dire un poison et un remède à la fois. A l’instar des médicaments, l’IA est donc, selon son « dosage », plus ou moins curative et/ou toxique. Quand on parle d’augmentation, il convient d’interroger ce qui est présumé ne pas suffire dans ce que nous sommes. Quel idéal, notamment de performance, l’augmentation vise-t-elle ? Il faut aussi observer quelle(s) « diminution(s) » cette augmentation peut entraîner.

— Julien : On parle beaucoup des craintes (légitimes) que l’IA suscite en termes de perte d’emploi. Mais c’est loin d’être le seul type de perte en jeu. Une approche saine des mutations induites par l’IA doit absolument prendre en compte les phénomènes de prolétarisation, c’est-à-dire de perte de savoirs (savoir-être et savoir-faire), qu’elle peut engendrer. Ces pertes peuvent concerner la créativité, l’autonomie, le libre-arbitre, la capacité décisionnelle (ou a minima le sentiment de maitrise) ou encore le mérite. Avant de déployer des IA et d’interroger les compétences que les managers vont devoir développer pour évaluer la performance des membres de leurs équipes, il est plus que nécessaire d’interroger les compétences que ces personnes veulent conserver, développer et acquérir pour « performer » et continuer de se sentir sujets de leur performance tout en vivant bien au travail.

Dans le monde de l'IA ce mois-ci…

La découverte du mois, c’est Dust.

C’est un outil de productivité alimenté par l'IA, conçu pour améliorer la compréhension des sujets, augmenter la productivité en assistant dans les tâches et améliorer les processus de travail. Il fournit des réponses adaptées au contexte, en exploitant les sources de connaissances internes à l’entreprise.

On l’utilise beaucoup (beaucoup!) chez Alan. Maxime a récemment partagé des cas d’usages applicables au recrutement (vidéo de 55’).

👋 Rendez-vous dans un mois,

— Charles & Maxime